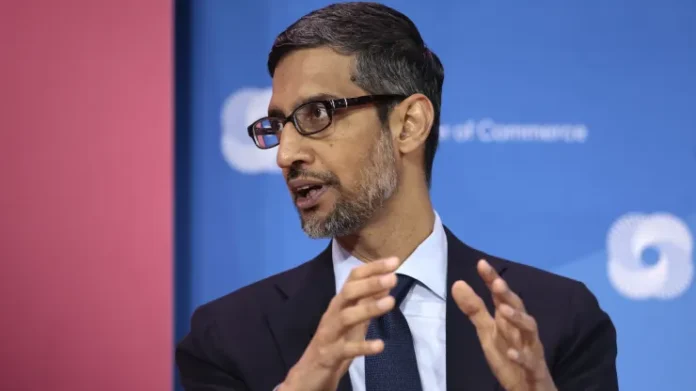

Le PDG Sundar Pichai a déclaré que « chaque produit de chaque entreprise » sera impacté par le développement rapide de l’IA, avertissant que la société doit se préparer à des technologies comme celles qu’elle a déjà lancées.

Dans une interview avec « 60 Minutes » de CBS diffusée dimanche qui a pris un ton inquiet, l’intervieweur Scott Pelley a essayé plusieurs des projets d’IA de Google et a déclaré qu’il était « sans voix » et qu’il pensait que c’était « troublant », se référant aux capacités humaines. de produits comme le chatbot Bard de Google.

« Nous devons nous adapter en tant que société pour cela », a déclaré Pichai à Pelley, ajoutant que les emplois qui seraient perturbés par l’IA incluraient des « travailleurs du savoir », notamment des écrivains, des comptables, des architectes et, ironiquement, même des ingénieurs en logiciel.

« Cela va avoir un impact sur tous les produits de toutes les entreprises », a déclaré Pichai. «Par exemple, vous pourriez être radiologue, si vous pensez que dans cinq à dix ans, vous allez avoir un collaborateur IA avec vous. Vous venez le matin, disons que vous avez une centaine de choses à traverser, cela peut dire, « ce sont les cas les plus graves que vous devez examiner en premier ».

Pelley a vu d’autres domaines avec des produits d’IA avancés au sein de Google, y compris DeepMind, où les robots jouaient au football, qu’ils ont appris eux-mêmes, par opposition aux humains. Une autre unité montrait des robots qui reconnaissaient des objets sur un comptoir et allaient chercher à Pelley une pomme qu’il demandait.

En avertissant des conséquences de l’IA, Pichai a déclaré que l’ampleur du problème de la désinformation et des fausses nouvelles et images sera « beaucoup plus grande », ajoutant que « cela pourrait causer des dommages ».

Le mois dernier, CNBC a rapporté qu’en interne, Pichai avait déclaré aux employés que le succès de son nouveau programme Bard dépendait désormais des tests publics, ajoutant que « les choses iraient mal ».

Google a lancé son chatbot AI Bard en tant que produit expérimental au public le mois dernier. Cela faisait suite à l’annonce de Microsoft en janvier selon laquelle son moteur de recherche Bing inclurait la technologie GPT d’OpenAI, qui a attiré l’attention internationale après le lancement de ChatGPT en 2022.

Cependant, les craintes des conséquences des progrès rapides ont également atteint le public et les critiques ces dernières semaines. En mars, Elon Musk, Steve Wozniak et des dizaines d’universitaires ont appelé à une pause immédiate dans les « expériences » de formation liées à de grands modèles de langage qui étaient « plus puissants que GPT-4 », le LLM phare d’OpenAI. Plus de 25 000 personnes ont signé la lettre depuis lors.

« La pression concurrentielle entre des géants comme Google et des startups dont vous n’avez jamais entendu parler propulse l’humanité vers l’avenir, prête ou non », a commenté Pelley dans le segment.

Google a lancé un document décrivant des « recommandations pour réglementer l’IA », mais Pichai a déclaré que la société doit s’adapter rapidement à la réglementation, aux lois pour punir les abus et aux traités entre les nations pour rendre l’IA sûre pour le monde, ainsi qu’à des règles qui « s’alignent sur les valeurs humaines, y compris la moralité ». . »

« Ce n’est pas à une entreprise de décider », a déclaré Pichai. « C’est pourquoi je pense que le développement de cela doit inclure non seulement des ingénieurs, mais aussi des spécialistes des sciences sociales, des éthiciens, des philosophes, etc. »

Lorsqu’on lui a demandé si la société était préparée à la technologie de l’IA comme Bard, Pichai a répondu : « D’une part, je pense que non, car le rythme auquel nous pouvons penser et nous adapter en tant qu’institutions sociétales, par rapport au rythme auquel la technologie évolue, il semble être un décalage. »

Cependant, il a ajouté qu’il était optimiste car par rapport à d’autres technologies dans le passé, « le nombre de personnes qui ont commencé à s’inquiéter des implications » l’ont fait très tôt.

À partir d’une invite de six mots de Pelley, Bard a créé un conte avec des personnages et une intrigue qu’il a inventés, y compris un homme dont la femme ne pouvait pas concevoir et un étranger pleurant après une fausse couche et aspirant à la fermeture. « Je suis rarement sans voix », a déclaré Pelley. « L’humanité à une vitesse surhumaine a été un choc. »

Pelley a dit qu’il avait demandé à Bard pourquoi cela aidait les gens et il avait répondu « parce que cela me rend heureux », ce qui, selon Pelley, l’a choqué. « Bard semble réfléchir », a-t-il déclaré à James Manyika, vice-président senior de Google embauché l’année dernière en tant que responsable « technologie et société ». Manyika a répondu que Bard n’est pas sensible et n’est pas conscient de lui-même, mais qu’il peut « se comporter comme » lui.

Pichai a également déclaré que Bard avait beaucoup d’hallucinations après que Pelley ait expliqué qu’il avait interrogé Bard sur l’inflation et avait reçu une réponse instantanée avec des suggestions pour cinq livres qui, lorsqu’il a vérifié plus tard, n’existaient pas réellement.

Pelley a également semblé inquiet lorsque Pichai a déclaré qu’il y avait « une boîte noire » avec des chatbots, où « vous ne comprenez pas parfaitement » pourquoi ou comment cela donne certaines réponses.

« Vous ne comprenez pas entièrement comment cela fonctionne et pourtant vous l’avez lâché sur la société? » a demandé Pelley.

« Permettez-moi de le dire ainsi, je ne pense pas que nous comprenions pleinement non plus le fonctionnement d’un esprit humain », a répondu Pichai.

Source: www.cnbc.com